Presentan legislación para proteger a víctimas de ‘pornografía de venganza’ en EEUU

Un proyecto de ley bipartidista para proteger a las víctimas de la llamada “pornografía de la venganza”, real y falsa, que está afectando cada vez más a los jóvenes en Estados Unidos, fue presentado por cuatro congresistas, incluyendo una representante de Florida.

Los legisladores dijeron que el crecimiento de las imágenes íntimas no consensuales (NCII), más comúnmente conocidas como “pornografía de venganza”, tras la creciente popularidad de la Inteligencia Artificial (IA) requiere protecciones legales decisivas que empoderen a las víctimas, la mayoría de las cuales son mujeres y niñas.

El proyecto de ley “Take it Down” penaliza la publicación de estas imágenes dañinas y exige que los sitios web las eliminen rápidamente.

“El alarmante aumento de los deepfakes amenaza con destruir las vidas de personas y familias inocentes”, dijo la representante María Elvira Salazar (R-FL), quien lidera el proyecto que presentó con Madeleine Dean (D-PA), August Pfluger (R-TX), Stacey Plaskett (D-VI), Vern Buchanan (R-FL) y Debbie Dingell (D-MI).

Salazar afirmó que “las imágenes deepfake no consensuadas son un cáncer que ya no puede dejar de tratarse. La Ley Take it Down es la mejor manera de responsabilizar a las plataformas en línea y proteger a las víctimas de estos horrendos crímenes”.

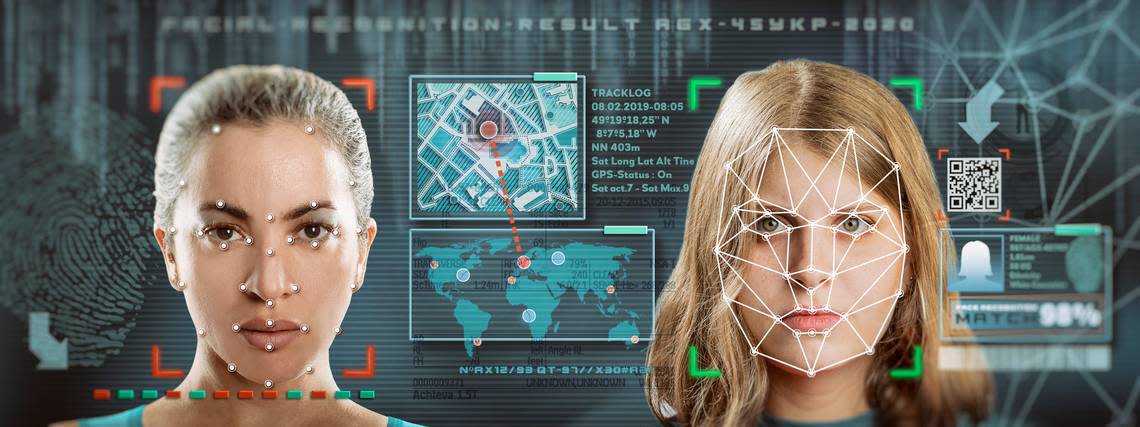

El término “deepfake” se refiere a la fusión de IA con medios manipulados, creando falsificaciones convincentes en imágenes, vídeos o grabaciones de audio. Utilizando el aprendizaje automático avanzado (ML), emulan meticulosamente a personas reales, ampliando los límites de nuestra capacidad para distinguir entre contenido digital auténtico y manipulado, de acuerdo con la plataforma Veridas.

Lea más: Actriz Mischa Barton víctima de venganza pornográfica

“La legalidad de los deepfakes puede variar en función de varios factores, como la jurisdicción y el uso específico de la tecnología. En muchos lugares, crear y compartir contenidos deepfake sin el consentimiento de las personas implicadas puede plantear problemas legales y éticos”, se indicó en el Website.

Los congresistas explicaron que el proyecto de ley resuelve el problema de la legislación “inconsistente o inexistente que protege a las víctimas de imágenes pornográficas ultra falsas a nivel estatal. Si bien casi todos los estados tienen leyes que protegen a sus ciudadanos de la pornografía de venganza, solo 20 tienen leyes explícitas que cubren las imágenes íntimas no consensuales (NCII)“.

En esos 20 estados existe un alto grado de variación en la clasificación de delitos, penas e incluso procesos penales. Las víctimas también luchan para que las imágenes que las representan sean eliminadas de los sitios web de manera oportuna, lo que podría contribuir a una mayor propagación y retraumatización, dijeron.

Medidas de protección

En 2022, el Congreso aprobó una legislación que creaba una causa de acción civil para que las víctimas demandaran a las personas responsables de la publicación del NCII.

Sin embargo, iniciar una acción civil puede resultar increíblemente impráctico. Lleva mucho tiempo, es costoso y puede obligar a las víctimas a revivir el trauma. Para agravar aún más el problema, no siempre está claro quién es responsable de publicar el NCII, detalló Salazar.

“Take it Down” aborda estas cuestiones y al mismo tiempo establece penalizar la publicación del NCII o la amenaza de publicar el NCII en el comercio interestatal y proteger los esfuerzos de buena fe para ayudar a las víctimas al permitir la divulgación de buena fe del NCII con fines de aplicación de la ley o tratamiento médico.

Lea más: Proyecto de abogados de Miami ayuda a víctimas de venganza porno

También exige a los sitios web que eliminen NCII previa notificación de las víctimas dentro de las 48 horas y que el NCII generado por computadora cumpla con una prueba de “persona razonable” por parecer que representa de manera realista a un individuo, a fin de cumplir con la jurisprudencia actual de la Primera Enmienda.

Los legisladores dijeron que si bien algunos estados brindan recursos legales para las víctimas de imágenes íntimas no consensuadas, los estados contarían además con un estatuto federal uniforme que ayude a eliminar y procesar la publicación de imágenes íntimas no consensuales en todo el país.

Yahoo Noticias

Yahoo Noticias