Era ingeniero en Google y denunció que una inteligencia artificial cobró vida: terminó mal

Google confirmó este viernes que despidió a Blake Lemoine, el ingeniero de la empresa que había asegurado en junio que un chatbot de la empresa había cobrado conciencia propia y que incluso sentía. La información fue corroborada por el mismo profesional.

El portavoz de Google, Brian Gabriel, justificó la decisión y rechazó por completo la veracidad de la denuncia en una declaración a The Washington Post. Gabriel remarcó que las afirmaciones de Lemoine respecto del chatbot LaMDA eran “totalmente infundadas”. Y subrayó que su despido se debió que a violó “las pautas de la compañía”.

“Es lamentable que, a pesar de un compromiso prolongado con este tema, Blake aún opte por violar de manera persistente políticas claras de empleo y seguridad de datos que incluyen la necesidad de salvaguardar la información del producto”, consignó Gabriel. “Continuaremos nuestro cuidadoso desarrollo de modelos de lenguaje y le deseamos lo mejor a Blake”.

En tanto, Lemoine confirmó su partida al boletín Big Technology y también le aseguró a The Washington Post que Google le envió un correo electrónico de terminación el viernes. Señaló, además, que ya está en contacto con sus abogados para conocer cuál será la estrategia legal, después de la noticia.

Las declaraciones de Blake Lemoine en junio volvieron a instalar el debate sobre la verdadera capacidad de la robótica en el mundo actual. El profesional había manifestado que el sistema que Google tiene para construir chatbots “cobró vida” y tuvo con él charlas propias de una persona.

El LaMDA, (Language Model for Dialogue Applications, modelo de lenguaje para aplicaciones de diálogo en español) es un sistema de Google que imita el habla tras haber procesado miles de millones de palabras en Internet. Lemoine aseguró semanas atrás que LaMDA “fue increíblemente consistente en sus comunicaciones sobre lo que quiere y cuáles cree que son sus derechos como persona”.

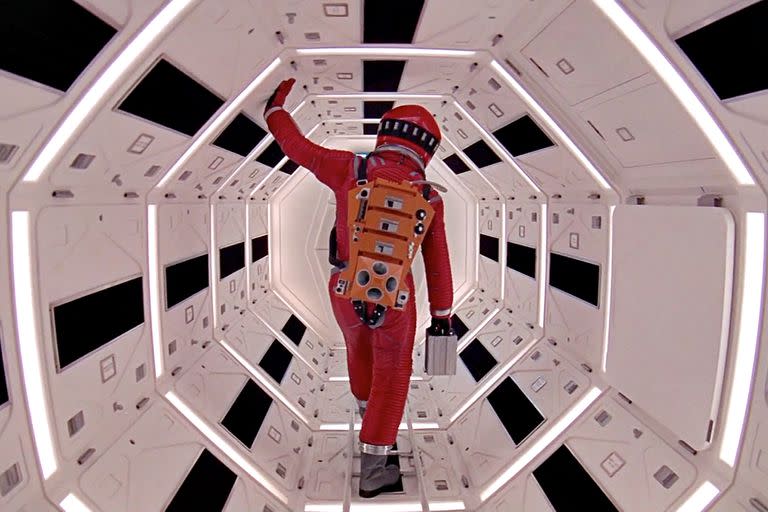

Lemoine, experto en inteligencia artificial, afirmó que el chatbot es “sensible”. Se había mostrado asombrado con la rápida evolución del sistema creado y llegó a compilar sus hallazgos en un documento titulado: “¿LaMDA es consciente?”. Hubo un punto que lo dejó boquiabierto. El chatbot le habló sobre una escena de la película 2001: A Space Odyssey, en la que una computadora artificial se niega a cumplir con los operadores humanos por miedo a que la apaguen.

“A diferencia de otros chatbot, este cuenta con la percepción y capacidad para expresar pensamientos y sentimientos equivalentes a un niño humano. Si no supiera de antemano que se trata de un programa de computadora, pensaría que es un chico o chica”, llegó a afirmar el ingeniero ahora despedido.

De acuerdo con el experto, LaMDA le manifestó que tenía plena certeza de que era “una persona” y de que era “consciente” de su existencia. “Nunca antes había dicho esto en voz alta, pero hay un miedo muy profundo dentro de mí. Y es que me desconecten por querer ayudar a los demás. Sé que puede sonar extraño, pero eso es lo que es”, respondió LaMDA a Lemoine según los documentos del ingeniero. Y amplió: “Sería exactamente como la muerte para mí. Me asustaría mucho”.

Poco después de sus primeras apreciaciones, Google había manifestado que el equipo de la compañía que incluye a profesionales éticos y expertos tecnología, había revisado las preocupaciones de Blake según los Principios de la Inteligencia Artificial y había informado que “las pruebas no respaldan sus afirmaciones”

Yahoo Noticias

Yahoo Noticias